Интересные / перспективные модели ИИ / Агенты / MCP

- Автор темы Sleepwalker

- Дата начала

mem-agent — агент с памятью в стиле Obsidian

Лёгкая LLM-модель, которая умеет хранить знания в человеко-читаемой памяти (Markdown-файлы) и использовать их для ответов. Агент не просто отвечает на запросы, а действительно «помнит» факты и обновляет их по ходу работы.

Это агент на 4B с локальной, совместимой памятью для Claude, ChatGPT и LM Studio.

Как работает память:

- Вся информация лежит в Markdown: memory/user.md и отдельные файлы для сущностей.

- Связи между файлами сделаны как в Obsidian: [[entity]].

- Агент может извлекать факты, обновлять их или задавать уточняющие вопросы, если запрос неполный.

Вместо огромных контекстов и упора в лимиты, Mem-Agent извлекает нужные фрагменты из локальных документов, сжимает их и передаёт агенту.

Как обучали:

- Базовая модель: Qwen3-4B-Thinking-2507.

- Использовали метод онлайн-RL (GSPO).

- Тестировали на md-memory-bench.

Результаты:

- mem-agent уверенно решает задачи памяти, близко к уровню больших моделей.

- Даже в сжатых версиях (4-bit и 8-bit) сохраняет почти то же качество.

Чем хорош:

- Память можно читать и редактировать вручную.

- Агент работает быстро и эффективно, даже в маленьком размере.

- Удобен как компонент в более крупных системах (например, через MCP).

Model: https://huggingface.co/driaforall/mem-agent

Blog: https://huggingface.co/blog/driaforall/mem-agent

Repo: https://github.com/firstbatchxyz/mem-agent-mcp

@ai_machinelearning_big_data

Лёгкая LLM-модель, которая умеет хранить знания в человеко-читаемой памяти (Markdown-файлы) и использовать их для ответов. Агент не просто отвечает на запросы, а действительно «помнит» факты и обновляет их по ходу работы.

Это агент на 4B с локальной, совместимой памятью для Claude, ChatGPT и LM Studio.

Как работает память:

- Вся информация лежит в Markdown: memory/user.md и отдельные файлы для сущностей.

- Связи между файлами сделаны как в Obsidian: [[entity]].

- Агент может извлекать факты, обновлять их или задавать уточняющие вопросы, если запрос неполный.

Вместо огромных контекстов и упора в лимиты, Mem-Agent извлекает нужные фрагменты из локальных документов, сжимает их и передаёт агенту.

Как обучали:

- Базовая модель: Qwen3-4B-Thinking-2507.

- Использовали метод онлайн-RL (GSPO).

- Тестировали на md-memory-bench.

Результаты:

- mem-agent уверенно решает задачи памяти, близко к уровню больших моделей.

- Даже в сжатых версиях (4-bit и 8-bit) сохраняет почти то же качество.

Чем хорош:

- Память можно читать и редактировать вручную.

- Агент работает быстро и эффективно, даже в маленьком размере.

- Удобен как компонент в более крупных системах (например, через MCP).

Model: https://huggingface.co/driaforall/mem-agent

Blog: https://huggingface.co/blog/driaforall/mem-agent

Repo: https://github.com/firstbatchxyz/mem-agent-mcp

@ai_machinelearning_big_data

Используем API ChatGPT бесплатно (ну почти) — вышла тулза, которая позволяет использовать ваш диалог с нейронкой вместо запросов по API.

ChatMock создает виртуальный сервер, через него делает запросы к ChatGPT, а вы получаете API, который можно использовать в любых сторонних сервисах — хоть для вайбкодинга, хоть для написания книг.

Нужна хотя бы базовая подписка и пробуем

https://github.com/RayBytes/ChatMock

Не модель, но оч полезная штука =)

ChatMock создает виртуальный сервер, через него делает запросы к ChatGPT, а вы получаете API, который можно использовать в любых сторонних сервисах — хоть для вайбкодинга, хоть для написания книг.

Нужна хотя бы базовая подписка и пробуем

https://github.com/RayBytes/ChatMock

Не модель, но оч полезная штука =)

На днях начал гонять https://chat.qwen.ai/

Скажу, что очень достойно и абсолютно бесплатно.

Короткий код пишет без ошибок, контекст помнит.

Не гпт, но бесплатно и не ноет, что нарушаю закон =)

Скажу, что очень достойно и абсолютно бесплатно.

Короткий код пишет без ошибок, контекст помнит.

Не гпт, но бесплатно и не ноет, что нарушаю закон =)

Agent S: Use Computer Like a Human

Релиз Agent S3 - продвинутый агент для работы с компьютером, который приближается к человеческому уровню.

Вместо того, чтобы усложнять одну модель, авторы запускают несколько агентов параллельно и затем выбирают лучший результат.

Метод назвили **Behavior Best-of-N (https://arxiv.org/pdf/2510.02250)(bBoN).

Как работает:

- Каждый агент пробует решить задачу.

- Его действия переводятся в поведенческий нарратив - короткое описание, что реально изменилось на экране.

- Специальный судья сравнивает эти нарративы и выбирает лучший.

Результаты:

- GPT-5 с 10 параллельными агентами → 69.9% успеха

- Для примера у GPT-5 Mini → 60.2%

- Agent S3* набирает на +10% выше предыдущей SOTA

https://github.com/simular-ai/Agent-S

Релиз Agent S3 - продвинутый агент для работы с компьютером, который приближается к человеческому уровню.

Вместо того, чтобы усложнять одну модель, авторы запускают несколько агентов параллельно и затем выбирают лучший результат.

Метод назвили **Behavior Best-of-N (https://arxiv.org/pdf/2510.02250)(bBoN).

Как работает:

- Каждый агент пробует решить задачу.

- Его действия переводятся в поведенческий нарратив - короткое описание, что реально изменилось на экране.

- Специальный судья сравнивает эти нарративы и выбирает лучший.

Результаты:

- GPT-5 с 10 параллельными агентами → 69.9% успеха

- Для примера у GPT-5 Mini → 60.2%

- Agent S3* набирает на +10% выше предыдущей SOTA

https://github.com/simular-ai/Agent-S

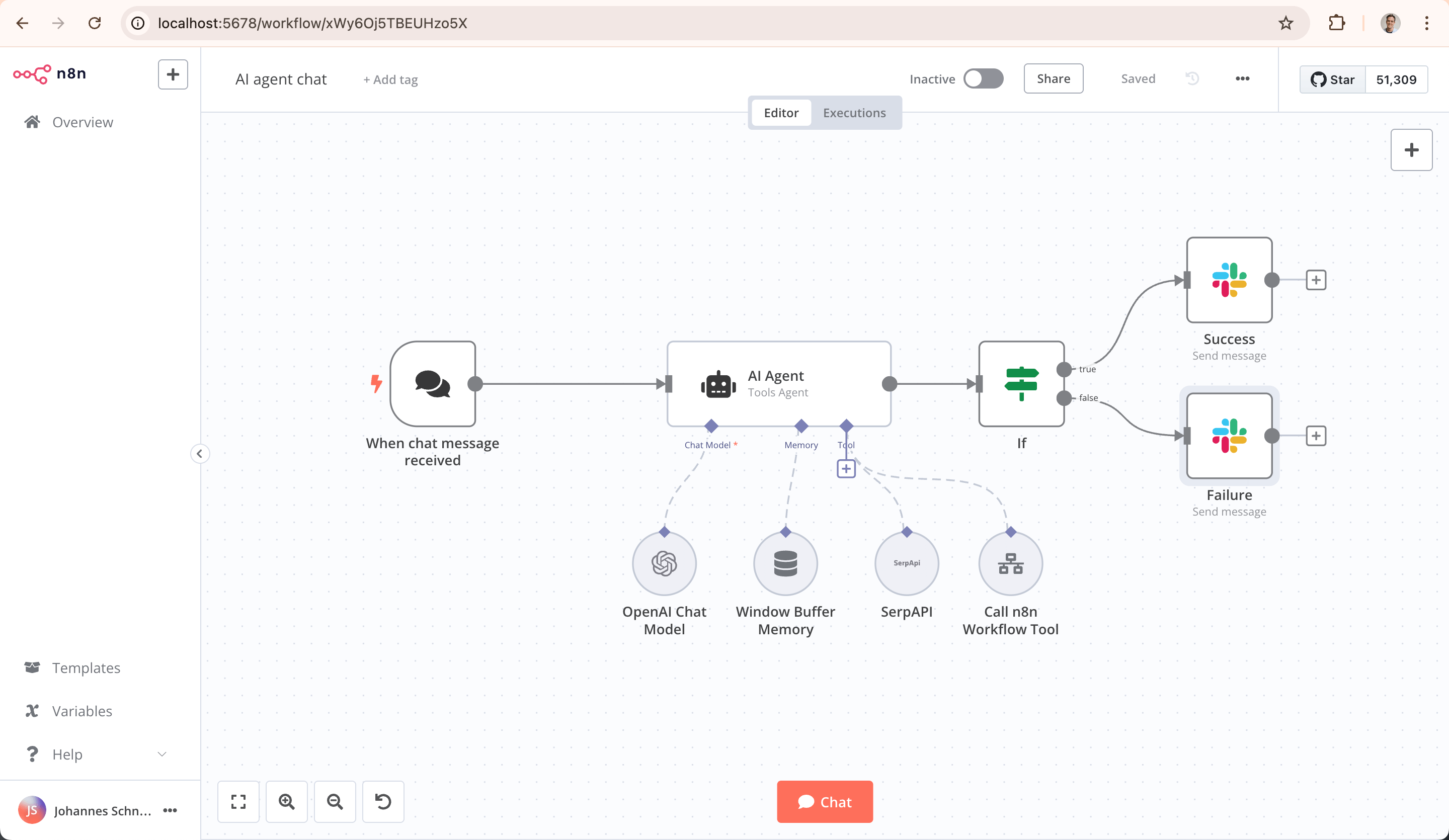

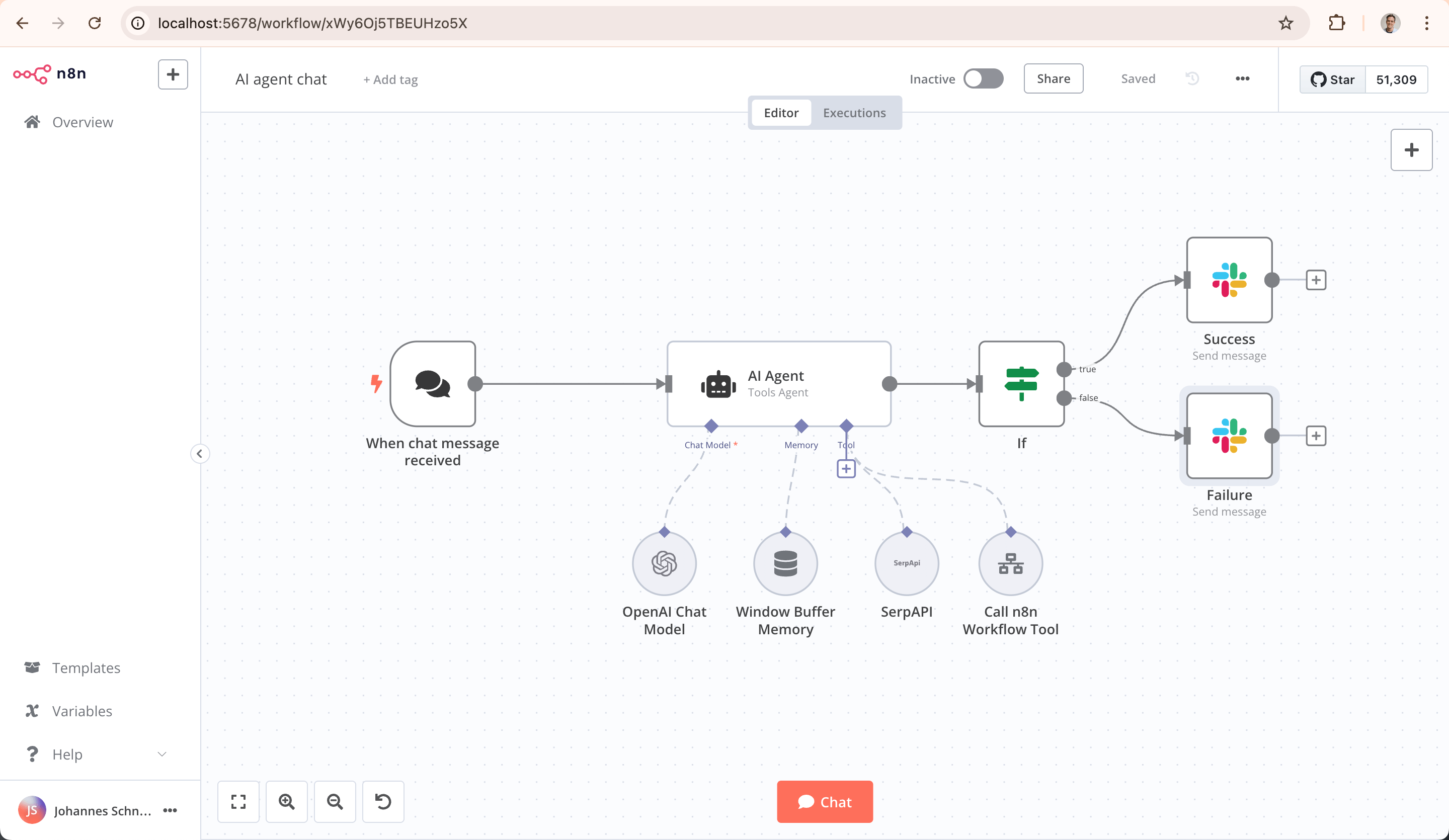

ИИИИИИИИИИИ конечно же n8n!

https://github.com/n8n-io/n8n

Это просто имба.

От работы за станками и с кодом до абсюлютно любых задач.

Локально. Мощно. Развивается.

Поразительная штука!

https://github.com/n8n-io/n8n

Это просто имба.

От работы за станками и с кодом до абсюлютно любых задач.

Локально. Мощно. Развивается.

Поразительная штука!